Yakarta, CNN Indonesia —

Fotos de la detención del presidente de Venezuela Nicolás Maduro ampliamente compartido en las redes sociales. Sin embargo, resulta que no todas estas fotos son originales, sino que algunas son resultado de ellas. inteligencia artificial (AI).

Poco después de que el expresidente estadounidense Donald Trump anunciara un gran ataque contra Venezuela la madrugada del sábado, el mundo de las redes sociales se llenó inmediatamente de una ola de desinformación en forma de imágenes y vídeos falsos creados con tecnología de inteligencia artificial.

PUBLICIDAD

Desplácese para continuar con el contenido

El contenido engañoso incluye fotografías manipuladas que parecen mostrar al presidente venezolano Nicolás Maduro siendo escoltado fuera de un avión por agentes de policía de Estados Unidos.

Además, circularon imágenes de venezolanos que decían celebrar el ataque saliendo a las calles de Caracas, así como un video falso que mostraba una lluvia de cohetes impactando la ciudad.

comenzar el guardián El martes (1 de junio), este contenido falso se mezcló con vídeos y fotografías reales de aviones militares estadounidenses sobrevolando la capital venezolana y explosiones iluminando el cielo nocturno.

La incertidumbre de la información verificada sobre los ataques, junto con la rápida evolución de herramientas de inteligencia falsificadas, hace que sea difícil distinguir la realidad de la ficción sobre los ataques de Caracas.

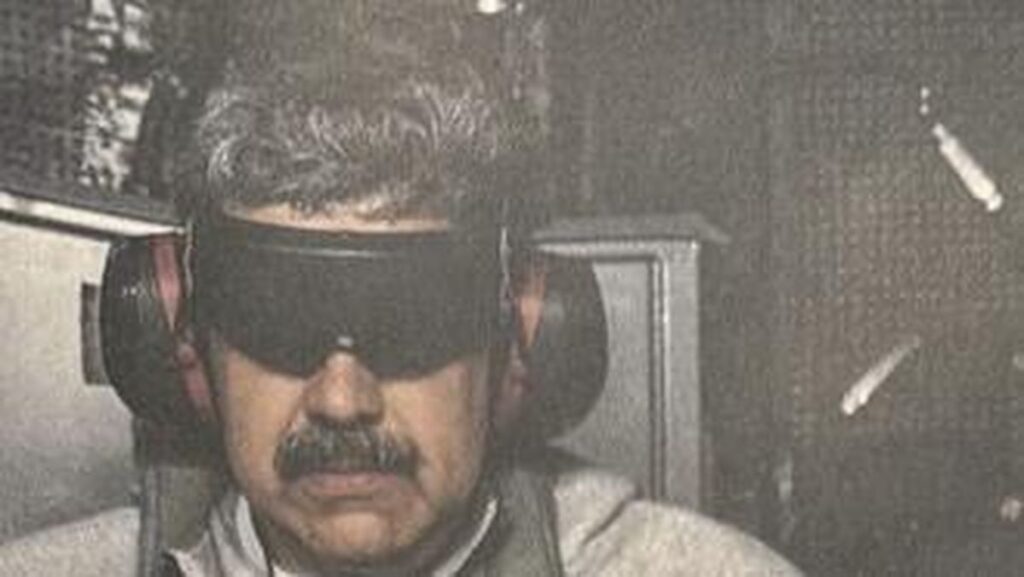

Cuando Trump publicó una foto verificada de Maduro esposado, con los ojos vendados y con pantalones deportivos grises a bordo del buque de guerra USS Iwo Jima, una imagen falsa que mostraba a un agente de la Agencia Antidrogas de Estados Unidos (DEA) se volvió viral.

Según el sitio de verificación de datos NewsGuard, las fotos de la IA han sido vistas y compartidas millones de veces en X, Instagram, Facebook y TikTok.

Hasta el momento, plataformas de redes sociales como Meta, X o TikTok no se han pronunciado sobre este tema.

Distribución a través de influencers

Las fotos y videos del arresto de Maduro generados por IA pueden compartirse ampliamente y son inseparables del papel de personas influyentes y funcionarios. Fueron grabados compartiendo contenido falso generado por IA en sus cuentas de redes sociales.

Por ejemplo, Vince Lago, alcalde de Coral Gables, Florida, publicó una foto falsa en Instagram de Maduro escoltado por agentes de la DEA. Lo subtituló diciendo que el presidente venezolano es “el líder de una organización narcoterrorista que amenaza a nuestro país”.

La publicación recibió más de 1.500 me gusta y todavía es visible hoy.

Aunque herramientas como la búsqueda inversa de imágenes y los sitios de reconocimiento de inteligencia artificial pueden ayudar a evaluar la precisión de las imágenes en línea, son inconsistentes.

Sofia Rubinson, editora senior de NewsGuard que investiga la desinformación y las teorías de conspiración, dijo que las fotos falsas sobre Caracas se parecían a eventos reales, lo que hacía cada vez más difícil distinguir entre las reales.

“Muchas de las imágenes fuera de contexto generadas por IA que actualmente inundan las redes sociales no distorsionan drásticamente los hechos sobre el terreno”, dijo Rubinson.

El uso de imágenes falsas generadas por IA y secuencias dramáticas fuera de contexto se utiliza para llenar los vacíos en los informes en tiempo real. Esta práctica se considera otra táctica en la guerra de desinformación que cada vez resulta más difícil de detectar para los verificadores de datos porque las imágenes a menudo parecen parecerse a la realidad.

El lunes por la tarde, NewsGuard publicó un informe identificando cinco fotografías y dos videos falsos y fuera de contexto relacionados con operaciones militares en Venezuela. Una imagen generada por inteligencia artificial parece mostrar a un soldado de pie junto a Maduro, que lleva un tocado negro.

Otro video fuera de contexto muestra un helicóptero de las fuerzas especiales estadounidenses aterrizando en un presunto sitio militar venezolano; El metraje original fue filmado en junio en la base militar de Fort Bragg en Carolina del Norte.

NewsGuard dijo que las siete fotos y videos engañosos identificados por la compañía han sido vistos más de 14 millones de veces solo en X.

También circularon en línea imágenes adicionales de eventos pasados que se presentaron como parte de la huelga del sábado.

Por ejemplo, Laura Loomer, una influyente de derecha y confidente de Trump, publicó imágenes del cartel del presidente venezolano en X y afirmó que “los venezolanos están derribando los carteles de Maduro”.

Sin embargo, según Wired, el metraje es de 2024. Desde entonces, Loomer eliminó la publicación.

Otro influyente de extrema derecha y teórico de la conspiración, Alex Jones, publicó un vídeo aéreo de la X que muestra a miles de personas vitoreando en Caracas.

“Millones de venezolanos salieron a las calles de Caracas y otras ciudades importantes para celebrar el derrocamiento del dictador comunista Nicolás Maduro”, escribió Jones.

Dijo que ahora es necesario aplicar la misma energía a HomeFront.

El vídeo, que todavía está disponible para ver, ha sido visto más de 2,2 millones de veces. Los comentarios en la publicación de Community Notes, la herramienta de moderación colaborativa de X, decían que el video tenía “al menos 18 meses”.

Una búsqueda de imágenes inversa muestra que las imágenes pertenecen en realidad a manifestaciones en Caracas tras la controvertida victoria presidencial de Maduro en julio de 2024.

El chatbot de IA de la plataforma, Grok, también cuestionó la cronología del vídeo de Jones, afirmando: “Las fuentes actuales de hoy no indican tal celebración en Caracas, sino más bien una reunión de partidarios de Maduro”.

(wpj/dmi)

(Gambas: vídeo de CNN)