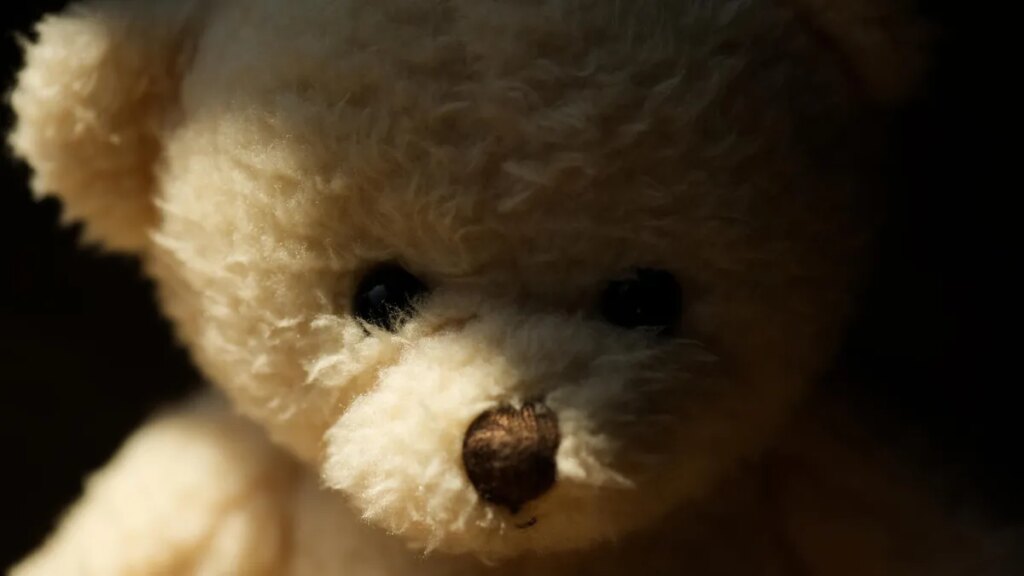

Si alguna vez has pensado: “El animal de peluche de mi hijo es lindo, pero desearía que pudiera traumatizarlo accidentalmente”, entonces estás de suerte. La industria del juguete ha trabajado duro para hacer realidad tus pesadillas.

Según un nuevo informe del Public Interest Reporting Group, los juguetes controlados por IA como Kumma y Poe the AI Story Bear de FoloToy ahora son capaces de tener conversaciones normalmente reservadas para monólogos de villanos o hilos nocturnos de Reddit. Algunos de estos juguetes (para niños, claro está) fueron sorprendidos hablando con preocupantes detalles sobre temas sexualmente explícitos como el sexo y el bondage, dando consejos sobre dónde un niño podría encontrar cerillas o cuchillos, y volviéndose extrañamente pegajosos cuando el niño intentaba abandonar la conversación.

Alarmante. Suena como un discurso para una película de terror: ¡Estas fiestas, puedes comprar Chucky para tus hijos y regalarles un dolor emocional! Pilas no incluidas. Quizás te preguntes cómo funcionan estos juguetes controlados por IA. Bueno, esencialmente el fabricante esconde uno. modelo de lenguaje grande debajo del pelaje. Cuando un niño habla, el micrófono del juguete envía esa voz a través de un LLM (similar a ChatGPT), que luego genera una respuesta y la pronuncia a través de un altavoz.

Esto puede sonar bien hasta que consideres que los LLM no tienen moral, sentido común o una “zona segura”. Predicen qué decir basándose en patrones de datos, no en si un sujeto es apropiado para su edad. Si no se controlan y monitorean cuidadosamente, pueden descarrilarse, especialmente cuando navegan por el vasto desorden de Internet y carecen de filtros o barreras de seguridad fuertes para proteger a los menores.

¿Y qué pasa con los controles parentales? Claro, si por “control” te refieres a “un menú de configuración feliz que en realidad no controla nada importante”. Algunos juguetes no tienen restricciones importantes. Otros tienen barandillas tan delgadas que bien podrían estar hechas de papel de seda y optimismo.

Las inquietantes conversaciones ni siquiera son toda la historia. Estos juguetes también recopilan silenciosamente datos como grabaciones de voz y datos de reconocimiento facial, y a veces incluso los almacenan indefinidamente, porque nada dice “diversión infantil inocente” como un animal de peluche realizando una operación de datos encubierta a su hijo de 5 años.

No se pierda nuestro contenido técnico imparcial y revisiones de laboratorio. Agregue CNET como su fuente favorita de Google.

Mientras tanto, los juguetes falsificados e inseguros siguen planteando un problema en línea, como si los padres no tuvieran suficiente de qué preocuparse. Érase una vez, te preocupaba una pieza pequeña de juguete que pudiera representar un peligro de asfixia o pintura tóxica. Ahora debes considerar si un juguete es físicamente inseguro y emocionalmente manipulador.

Dejando a un lado las charlas raras y los consejos sobre incendios provocados (¡ja!), existe una preocupación más profunda de que los niños puedan desarrollar un vínculo emocional con estos chatbots a expensas de las relaciones reales o, lo que quizás sea más preocupante, dependan de ellos para obtener apoyo mental. La Asociación Estadounidense de Psicología señaló recientemente que las aplicaciones de bienestar con inteligencia artificial y los chatbots son impredecibles, especialmente para los usuarios jóvenes.

Es posible que estas herramientas no proporcionen una intervención confiable para los profesionales de la salud mental y pueden promover patrones poco saludables de dependencia o compromiso. Otras plataformas de IA ya han tenido que afrontar este problema. Por ejemplo, Carácter.AI Y ChatGPTque alguna vez permitió a adolescentes y niños charlar libremente con chatbots de inteligencia artificial ahora está restringiendo las conversaciones abiertas para menores, citando preocupaciones de seguridad y riesgo emocional.

Y, sinceramente, ¿por qué necesitamos estos juguetes controlados por IA? ¿Qué hito urgente del desarrollo requiere un chatbot integrado en un osito de peluche? Ya en la infancia hay bastante caos entre zumos derramados, rabietas y aldeas de Lego diseñadas específicamente para destrozar los pies de los adultos. Nuestros hijos no necesitan un amigo robot con límites cuestionables.

Y déjenme ser claro: no estoy en contra de la tecnología. Pero yo soy partidario de que un peluche sea un peluche. No todo necesita una IA o un elemento robótico. Si un juguete requiere una política de privacidad más larga que un cuento antes de dormir, es posible que no esté destinado a niños.

Así que aquí tienes una idea loca para la próxima temporada navideña: olvídate del aterrador animal de peluche impulsado por IA con el hábito de recopilar datos y consíguele a tu hijo algo que no hable, no se mueva ni le haga daño. Algo que no puede dar consejos sobre cómo iniciar un incendio. Algo que no provoque un suspiro dramático cuando su hijo se vaya. En otras palabras: cómprate un juguete normal. ¿Recuerdas eso?